你一定遇過「同一指令、出來的影片品質卻像抽盲盒」的窘境:本質上是生成模型的隨機性在作祟。像是採樣策略(temperature、top-k/top-p)、隨機種子、訓練資料中的雜訊與偏差,以及視覺與語音等多模態對齊的不確定性,都會讓初稿在細節、節奏與風格上出現大幅變異。

理解這些來源可以幫助建立合理期待與流程:透過固定種子與參數範圍、分段生成與合成、引入範例影像與精細提示、設置自動化品質檢核與人力復核,可把「盲盒」機率降到最低。需要協助把流程落地與風險最小化,請聯絡雲祥網路橡皮擦團隊,擦掉負面,擦亮品牌。

優化 AI 影片穩定性的三大實用建議

- 建立「提示詞資產庫」:將已驗證的風格詞與參數組合標準化,減少重複試錯的時間成本,確保團隊不同成員產出的視覺調性維持統一。

- 實施「小樣預覽制」:先以低解析度、低採樣步數進行 10 組以上的批次生成,從中篩選出表現最優的 Seed 後,再進行高畫質算圖。

- 導入負面提示詞(Negative Prompt):結構化列出需排除的瑕疵,如「肢體重疊」、「畫面閃爍」或「物體形變」,強制模型避開特定的低品質機率區間。

Table of Contents

Toggle為什麼 AI 影片像抽盲盒?解析生成模型背後的隨機性與機率本質

對於習慣傳統影音剪輯「所見即所得」的行銷團隊來說,AI影片製作,為什麼初稿質量這麼難預測,核心原因在於底層技術從「確定性邏輯」轉向了「機率性生成」。主流的擴散模型(Diffusion Model)並非從素材庫中剪輯片段,而是從一片隨機的數位噪點(Noise)中,根據演算法預測並逐漸還原出符合描述的像素圖像。這意味著即使輸入完全相同的指令(Prompt),只要初始的隨機數種子(Seed)不同,生成的每一幀畫面都會產生細微或巨大的偏差。

擴散模型中的不確定因素:噪點與潛在空間

AI 在理解文字指令時,是在一個極其龐大的「潛在空間」(Latent Space)中進行搜索。模型會嘗試在數以億計的參數組合中,找到最接近描述的機率分佈。由於影片是由每秒 24 至 60 幀的靜止圖像組成,當前的生成技術在處理時間一致性(Temporal Consistency)時,難以保證每一幀的機率預測都能精準銜接。這正是為什麼人物的五官可能會在下一秒變形,或背景光影無端閃爍,因為對 AI 而言,每一幀都是一次新的「機率博弈」。

導致生成品質波動的三大核心變量

- 種子值(Seed):這是隨機性的起點,微小的數值變化會導致整個構圖與色彩傾向完全改觀。

- 相關性權重(CFG Scale):過高會導致畫面過度飽和或出現數位偽影,過低則會讓 AI 忽視指令,產生風馬牛不相及的內容。

- 採樣步數(Sampling Steps):步數不足會導致初稿模糊,而過高的步數在某些模型下反而會引入不必要的噪點干擾。

優化製程的執行重點:從「單次生成」轉向「批次篩選」

要解決「抽盲盒」的困擾,行銷經理不應期待單次生成即出成品,而應建立一套基於機率的內部質檢標準(QA Matrix)。一個可執行的判斷依據是:「先以低解析度進行 5-10 組批次生成,找出表現穩定的種子值(Seed),再針對該種子進行高畫質算圖與參數微調。」透過固定種子值並採取「先測小樣、後產大樣」的流程,能將原本不可控的隨機性,轉化為可預測的生產管線,有效降低溝通成本與時間浪費。

如何降低不確定性:透過結構化提示詞與種子值設定來引導 AI 產出

從「自然語言」轉向「參數化結構」

在探討 AI影片製作,為什麼初稿質量這麼難預測 時,最常見的痛點在於指令過於模糊。當前主流的生成模型(如 Sora 或 Gen-3 類型架構)本質上是在巨大的機率分佈中尋找圖像。若要提高產出穩定性,內容創作者應捨棄單純的敘述,改採「四維結構化提示詞」:主體細節(Subject)、動態動作(Motion)、鏡頭語法(Camera Movement)與光影風格(Lighting/Style)。透過明確區隔這些維度,可以減少 AI 在計算過程中的「自由發揮」,進而讓初稿更接近預期目標。

掌握種子值(Seed):鎖定影片的基因藍圖

隨機性是 AI 生成的本質,但「種子值」是唯一的控制閘門。每一個生成的影片背後都有一組隨機數列,稱為 Seed。如果您發現某次生成的構圖與風格非常理想,但細節(如人物動作)微瑕,請務必固定該組種子值。在固定 Seed 的前提下微調提示詞(Prompt Editing),能確保場景的一致性,避免每改一次指令就產出截然不同的內容。這是將「抽盲盒」轉變為「精密實驗」的技術關鍵。

提高成功率的可執行重點與判斷依據

- 權重分配原則: 在提示詞中使用括號或數值(如 (cinematic:1.5))來強調關鍵元素。當初稿偏離主題時,優先調高主體權重而非增加更多形容詞。

- 種子值鎖定策略: 若畫面構圖滿意但動作錯誤,固定 Seed 並修改動詞;若動作滿意但風格不對,固定 Seed 並修改風格詞。

- 負面提示詞(Negative Prompt)的應用: 明確排除「肢體畸形」、「畫面閃爍」或「低解析度」等標籤,從反向限制 AI 的隨機偏移量。

- 判斷依據: 若連續三次更換 Seed 仍無法產出正確構圖,代表該「提示詞組合」在模型潛在空間中不存在交集,應果斷重寫結構而非繼續消耗算力。

透過建立內部的提示詞資產庫(Prompt Library)與標準化的參數設定流程,行銷團隊能有效降低 AI 產出的熵值,讓技術從不可控的藝術創作,轉化為可預測的數位轉型生產力。

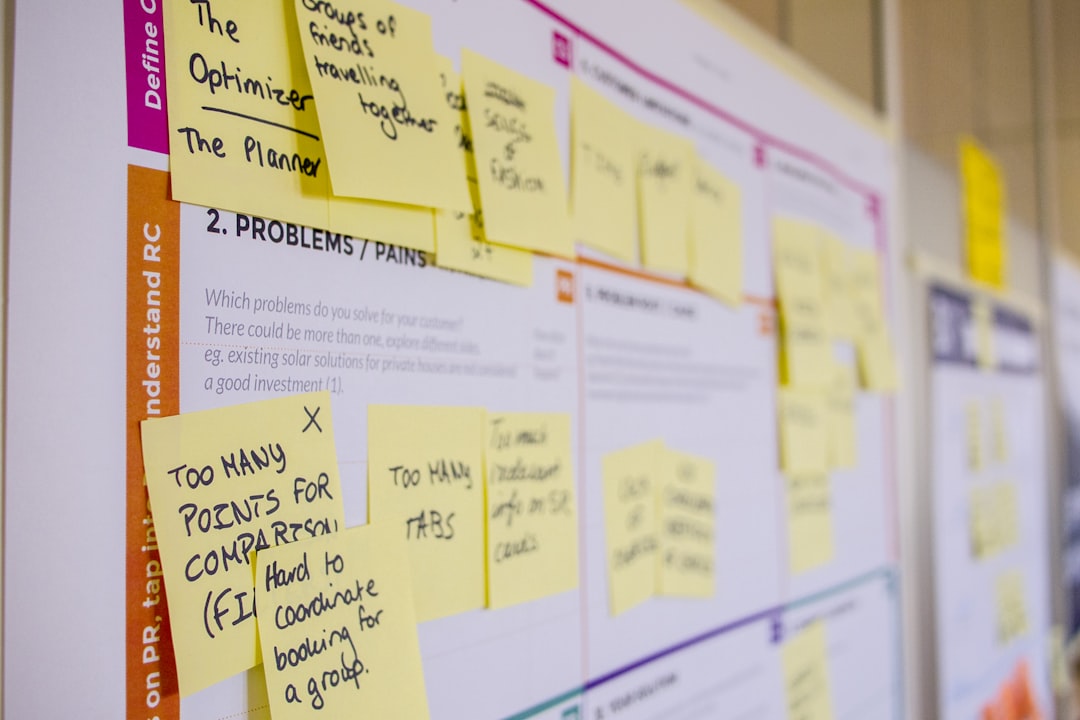

AI影片製作,為什麼初稿質量這麼難預測. Photos provided by unsplash

從單次生成到可控產製:利用混合工作流結合人工修飾提升成品率

探討AI影片製作,為什麼初稿質量這麼難預測的技術本質後,企業必須理解 AI並非「自動販賣機」,投入代幣就能直接產出成品,而是一個基於機率分佈的「創意助手」。目前業界領先的團隊已不再追求「一鍵生成」,而是轉向混合工作流(Hybrid Workflow),將長片段拆解為微小的模組,藉此抵銷模型生成的隨機偏誤。這意味著將重心從「測試指令」轉移到「流程控制」,才能在不穩定的技術現狀中,獲得可商業化的穩定產出。

模組化生成:拆解隨機性帶來的風險

要解決初稿質量的不可控,關鍵在於縮短 AI 每次生成的任務半徑。與其讓 AI 直接生成一段包含複雜運鏡與轉場的 30 秒影片,不如採用「圖生影(Image-to-Video)」的策略。透過 Midjourney 或 Stable Diffusion 先固定關鍵影格的視覺風格與構圖,再交由 Luma 或 Kling 等模型進行動態化。這種做法能確保視覺一致性不會在生成過程中產生劇烈偏差,並將原本不可控的隨機生成,轉化為可預期的局部動態填充。

建立「品質過濾機制」與人工修飾關鍵點

在混合工作流程中,人工的介入點不再是後製剪輯,而是「生成的篩選與合成」。專業行銷團隊應建立以下判斷依據來提升成品率:

- 物理邏輯驗證: 優先檢查物體邊緣的流體感與形變,若發生穿模或結構崩壞,應果斷重新生成局部而非整體。

- 多路徑併行(Multi-Pathing): 針對同一組提示詞同時生成 4 到 8 組候選片段。根據大數據觀察,AI 影片的高品質產出(Good Seed)通常只佔 15%-25%,透過數量規模化來對抗隨機性。

- 分層處理: 運用遮罩(Masking)技術,將背景環境與主體人物分開生成,最後在 AE 或 Premiere 中進行數位合成,這能大幅降低因畫面複雜度過高導致的「初稿翻車」機率。

可執行重點: 當面對高品質要求的專案時,建議導入「80/20 協作原則」。由 AI 完成 80% 的繁瑣畫面填充,剩下 20% 的關鍵動作細節與節奏對齊,則需依靠傳統 CG 軟體或人工剪輯介入。這種做法能讓原本低於三成的「直出成品率」,顯著提升至八成以上的「可修飾成品率」。

別陷入一鍵成片的誤區:建立多輪疊代思維,將技術限制轉化為創意動能

多數行銷團隊在導入自動化工具時,常誤將 AI 視為「自動販賣機」,期待輸入指令後直接獲得成品。然而,理解AI影片製作,為什麼初稿質量這麼難預測的本質,在於認清擴散模型(Diffusion Models)的運作邏輯:它是在高維度的機率空間中進行「去噪」取樣。每一次生成都是從隨機雜訊開始演化,這意味著技術層面上並不存在「唯一的正確答案」,只有「機率最高的視覺呈現」。

企業若想突破「抽盲盒」的困境,必須將工作流從「一次性生成」轉向「多輪疊代」。初稿不應被視為最終產出,而是作為測試模型對指令理解度的「視覺草圖」。透過初稿的反饋,創作者能觀察到模型在特定風格或動態邏輯上的偏差,進而精準修正提示詞(Prompt)或調整參數,這種循環開發的思維才是數位轉型的核心。與其不斷重新隨機生成,不如學會如何從不穩定的初稿中提取可用的視覺元素。

從隨機性中提取秩序:穩定產出的操作關鍵

要將不可控的隨機性轉化為可預期的產能,行銷經理應建立一套標準化的內部評核與製程規範,而非僅依賴 AI 的靈光一現。以下是優化製程的具體判斷依據:

- 種子值(Seed)固定法:當初稿出現令人滿意的構圖但細節不佳時,應鎖定該組種子值進行局部調整,而非更換整個指令。這是控制AI影片製作,為什麼初稿質量這麼難預測最直接的技術手段。

- 「結構優先」策略:先生成低解析度的動態骨架,確認運鏡與構圖符合需求後,再進行高畫質渲染與細節增強。這能大幅降低試錯的時間成本。

- 關鍵格引導(Keyframe Guiding):不要依賴純文字描述複雜動態,應提供參考圖或草圖作為控制條件(ControlNet),強制模型在既定的框架內進行預測。

執行重點:建立「70/30 原則」。由 AI 完成 70% 的視覺基礎建設,剩下 30% 的穩定性由人工透過參數微調、分鏡拼接與後製修正補足。當團隊不再追求「一鍵成片」,而是將 AI 視為高效的協作夥伴時,初稿的不確定性將不再是障礙,而是激發新創意動能的來源。

| 優化維度 | 解決問題 | 具體執行策略 |

|---|---|---|

| 模組化生成 | 視覺風格偏差 | 採「圖生影」策略,先以關鍵影格固定構圖再動態化 |

| 品質過濾 | 物理邏輯崩壞 | 檢查物體形變與穿模,果斷重新生成局部而非整體 |

| 多路徑併行 | 優質產出機率低 | 單一指令生成 4-8 組候選片段,從中篩選前 20% 優質種子 |

| 分層處理 | 畫面合成複雜度 | 運用遮罩分離背景與主體,於 AE 或 Premiere 數位合成 |

| 協作配置 | 關鍵動作失準 | 遵循 80/20 原則,由 AI 填充畫面、人工修飾節奏細節 |

AI影片製作,為什麼初稿質量這麼難預測結論

要回答「AI影片製作,為什麼初稿質量這麼難預測」,關鍵在於理解生成式 AI 運行的「隨機機率」本質。當行銷團隊能從「抽盲盒」的期待,轉向「控制變量」的邏輯,才能真正釋放數位轉型的潛力。穩定品質的關鍵不在於尋找完美的單一指令,而在於建立一套包含種子值鎖定、分層生成與人工質檢的結構化流程。透過將隨機性納入管理範疇,企業能將技術的不確定性轉化為高效的生產力。若您的品牌在數位轉型過程中遭遇內容品質起伏不定的負面影響,建議建立更專業的風控流程,或聯絡【雲祥網路橡皮擦團隊】擦掉負面,擦亮品牌 https://line.me/R/ti/p/%40dxr8765z

AI影片製作,為什麼初稿質量這麼難預測 常見問題快速FAQ

為什麼同樣的提示詞,每次生成的影片都不一樣?

因為模型每次運算都會調用不同的種子值(Seed)作為隨機起點,即便文字相同,去噪路徑的微小偏差也會導致完全不同的視覺結果。

如果影片構圖滿意但主體動作錯誤,該如何修正?

請務必固定該次生成的 Seed 值並微調動詞參數,這能確保在相同的視覺基調下優化動態,避免重新生成導致風格跑偏。

如何判斷一段提示詞是否已經失效?

若連續更換 5 組以上的 Seed 仍無法產出正確的主體結構,代表提示詞組合在模型空間中缺乏交集,應果斷重組結構而非浪費算力。